Einleitung

Seit der Entwicklung der ersten Mikroskopkameras haben Forscher und Anwender versucht, quantitative verwertbare Informationen aus Mikroskopbildern zu gewinnen, um ihre Forschung voranzutreiben und ihre Prozesse zu verbessern.Jede quantitative Analyse einer Reihe von Mikroskopbildern erfordert eine Form der Segmentierung. Als Segmentierung wird hierbei die Unterteilung von Bildern in bestimmte Bereiche bezeichnet, die als Grundlage für eine nachfolgende Kategorisierung und Analyse dient. Ein Bereich könnte zum Beispiel ein Mineralfragment, ein Korn in einem Metall, eine Pore in einem Verbundstoff, eine Ölverunreinigung an der Oberfläche oder ein Blutkörperchen sein, d. h. jeder Bereich, der sich von einem benachbarten Bereich abgrenzt. Durch die Analyse dieser Bereiche oder der Grenzen zwischen den Bereichen ergeben sich wertvolle Informationen. Es existieren verschiedene Normen dafür, wie geeignete Mikrostruktureigenschaften über eine Bildanalyse segmentierter Bilder zu bestimmen sind. Einige Beispiele sind die Korngrößenbestimmung (ASTM E112)[1], die Mikrostruktur von Gusseisen (EN ISO 945-1)[2], der Reinheitsgrad (ASTM E45)[3] oder die Porosität bei Keramikbeschichtungen (ASTM E2109)[4]. Diese Analysen sind jedoch abhängig von der Genauigkeit und Zuverlässigkeit der Segmentierungsergebnisse.

Die Herausforderung

Für eine quantitative Bildanalyse ist die Segmentierung unerlässlich – und dennoch gestaltet sie sich oft schwierig. Bei klassischen Segmentierungsmethoden wird die Graustufe bzw. Farbe von Bereichen anhand eines Schwellenwerts definiert. Dies stellt häufig eine Herausforderung dar, da Bereiche eine ähnliche Farbe und Helligkeit aufweisen können und sich nur anhand ihrer Textur, ihrer Form oder ihres Aussehens in einem bestimmten Kontrastmodus voneinander unterscheiden lassen.Eine weitere Schwierigkeit für den Anwender besteht darin, dass erkennbare Artefakte im Bild, wie Kratzer oder winzige Sprenkel, bei einer grundlegenden Schwellenwertanalyse mit tatsächlichen Merkmalen oder relevanten Bereichen verwechselt werden können. Insbesondere ist es schwierig, Strukturen zu segmentieren, die nur durch die Überlagerung verschiedener Kanäle oder sogar Aufnahmemethoden sichtbar werden. Dies ist in folgenden Beispielen der Fall: Farbdaten mit RGB-Kanälen oder zusammengesetzte Bilder mit mehreren Kanälen, die jeweils aus einem unterschiedlichen Polarisationswinkel erzeugt werden, unterschiedliche Fluoreszenzkanäle oder raumbezogene Datensätze, die von verschiedenen Instrumenten erfasst wurden. Darüber hinaus ist eine zeitaufwendige Präparation der Probe erforderlich, damit überhaupt erst hochwertige Bilder erstellt werden können. Bei 3D-Datensätzen ist zudem eine lange Aufnahmedauer einzuplanen, um das Rauschen zu verringern und eine Ausgabe zu erzeugen, die sich problemlos identifizieren lässt.

Wenn das System komplex und der Kontrast zwischen den Bildbereichen nicht deutlich erkennbar ist, wird ein erfahrener Bildverarbeitungsspezialist benötigt, der die zuvor genannten Herausforderungen meistert. Dabei wird typischerweise versucht, das Problem durch eine Kombination von verschiedenen Filtern und weiteren komplexen Prozessschritten zu lösen. Es kann jedoch sein, dass sich auch dadurch keine verwertbaren Daten ergeben. Dann muss der Anwender auf manuelle Analysemethoden zurückgreifen, die zu verzerrten Ergebnissen und wesentlich längeren Bearbeitungszeiten führen können.

Machine Learning – eine Lösung für das Segmentierungsproblem

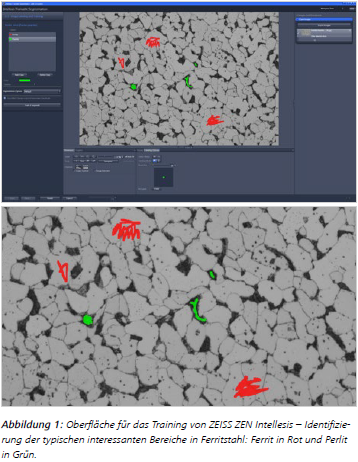

ZEISS ZEN Intellesis ist ein Modul für die ZEISS ZEN Mikroskopsteuerungssoftware. Dieses Tool kann in der ZEN Plattform oder auch in Verbindung mit anderen Softwareplattformen verwendet werden, um eine erste Datenerzeugung oder -analyse bzw. -verarbeitung eines segmentierten Bilds durchzuführen. Der Benutzer definiert ein Modell und „trainiert“ dieses dann, indem er Bereiche auf einem Bild, mehreren Bildern oder einem Teil eines größeren Datensatzes (2D oder 3D) kennzeichnet. Hierzu färbt er die verschiedenen Klassen oder Merkmale (Features), die von Interesse sind, auf dem Bild ein, wie in Abbildung 1 dargestellt.In dieser Studie verwenden wir ZEISS ZEN Intellesis, ein interaktives Machine Learning-Tool für die Segmentierung, das nach den folgenden Grundsätzen funktioniert. Für jedes Pixel im Bild wird ein Featurevektor erstellt, der aus einer Kombination von mehreren Intensitäts-, Textur- und Kantenfiltern erzeugt wird. Dann wird ein sogenannter „Random-Forest“-Klassifikator eingesetzt, der versucht, die vom User markierten Pixel anhand des Featurevektors korrekt zu klassifizieren. Diese „gelernte“ Klassifikation wird im Anschluss auf nicht markierte Pixel und Bildbereiche angewendet, um das Training zu verifizieren.

Zum Erzeugen der Trainingsbereiche wird eine iterative, interaktive Benutzeroberfläche verwendet. So kann der Benutzer in einem Teil der Bilddaten in erste Trainingsbereiche zeichnen. Dann erstellt die Benutzeroberfläche einen Segmentierungsalgorithmus für diesen Bereich des Datensatzes und überlagert die Daten mit den Ergebnissen. Der Benutzer überarbeitet die Markierungen, um so die Segmentierungsergebnisse der Machine Learning-Komponente zu verbessern, dieser weitere markierte Bereiche zur Verfügung zu stellen und so einen aktualisierten Segmentierungsalgorithmus zu erzeugen. Der Benutzer wiederholt diesen Vorgang so oft, bis er zufriedenstellende Ergebnisse erhält.

Sobald der Algorithmus auf einem Teil der Daten bzw. einem Bereich des Bildes trainiert wurde, kann er automatisiert auf viele Datensätze angewendet werden, die unter den gleichen Bildbedingungen aufgenommen wurden. Auf diese Weise lassen sich alle Mikroskopbilder automatisch segmentieren und eine einfache quantitative Analyse sowie die Wiederholbarkeit der Ergebnisse gewährleisten.

ZEISS ZEN Intellesis ist mit allen gängigen 2D- und 3D-Bildformaten kompatibel. Das Modul kann Einzelkanaldaten (wie Schwarz-Weiß-Bilder) oder Mehrkanaldaten (wie ein zusammengesetztes Bild aus einer Farblicht- und einer Rasterelektronen-Mikroskopaufnahme desselben Bereichs) verarbeiten. ZEISS ZEN Intellesis kann selbst für 6D-Datensätze, wie Kachelaufnahmen mit mehreren Kanälen und Z-Stapeln, verwendet werden. Im Folgenden werden einige praktische Anwendungen von ZEISS ZEN Intellesis für Industriewerkstoffe gezeigt – von Routineanalysen bis hin zur Spitzenforschung.

Analyse des Phasenanteils in Duplexstahl

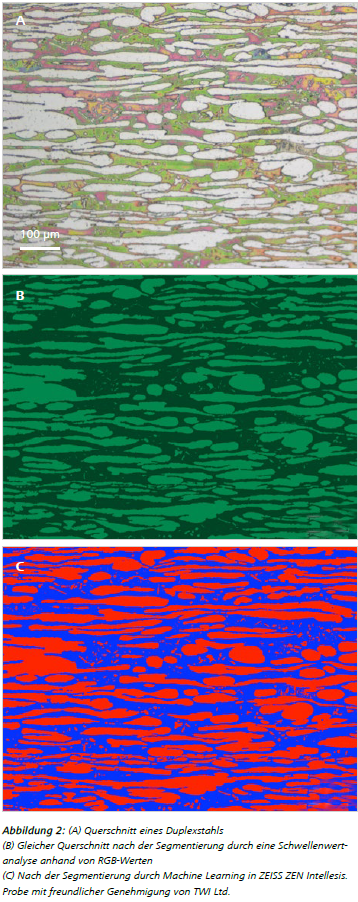

Austenitische Edelstähle sind hart, lassen sich relativ einfach schweißen und sind im Allgemeinen korrosionsbeständig (daher ihr vielseitiger Einsatz im Haushalt), können aber unter bestimmten Bedingungen anfällig für Spannungsrisskorrosion sein. Ferritische Edelstähle hingegen sind beständiger gegen Spannungsrisskorrosion, aber vergleichsweise spröde und schwieriger zu schweißen. Duplex-Edelstähle verfügen über ein ausgewogenes Zusammensetzungsverhältnis mit einem hohen Gehalt an Chrom und anderen Legierungselementen auf, was in einer Mikrostruktur resultiert, die aus etwa gleichen Anteilen an Ferrit und Austenit besteht. Durch die Verbindung der beiden ungleichen Phasen kann die Struktur mehrere Schwachstellen der einzelnen Phasen überwinden – der Stahl lässt sich relativ gut schweißen, ist aber auch beständig gegen Spannungsrisskorrosion. Duplexstähle werden in der Regel für bestimmte Einsatzbereiche genutzt, wenn es auf Korrosionsbeständigkeit, mechanische Festigkeit und Schweißbarkeit ankommt.Das Verhältnis von Austenit zu Ferrit hängt nicht nur von der Zusammensetzung, sondern auch vom Temperaturverlauf ab. Schweißbereiche und wärmebeanspruchte Zonen können unterschiedliche Verhältnisse von Austenit zu Ferrit und damit unterschiedliche lokale Eigenschaften aufweisen. Damit ein Metallurg das Verhalten des Stahls verstehen bzw. vorhersagen kann, muss er das Austenit-Ferrit-Verhältnis in diesen Bereichen ermitteln. Die metallografische Vorbereitung von Duplexstählen für die Darstellung von Austenit und Ferrit ist relativ einfach. Schwierig ist es jedoch, den Duplexstahl so zu ätzen, dass er sich für eine automatisierte Analyse anhand von Schwellenwerten eignet, insbesondere wenn die Korngröße des Austenits stark variiert.

Abbildung 2 zeigt ein beispielhaftes Mikroskopbild eines nicht geschweißten Duplexstahls nach dem Farbätzen. Die automatisierte Trennung des weißen Austenits vom hell gefärbten Ferrit anhand von RGB-Schwellenwerten ist für die größeren Austenitkörner erfolgreich, kleinere Austenitkörner lassen sich damit jedoch aufgrund von Ätzeffekten und Farbabweichungen des umgebenden Ferrits nur schwer erkennen. Mithilfe von Machine Learning kann ein Benutzer das Austenit vom Ferrit problemlos trennen – selbst bei kleineren Körnern. Bei Bildanalysen besteht immer ein Rest an Ungewissheit, wenn die genauen Grenzen zwischen den einzelnen Bereichen ermittelt werden müssen, aber mit Machine Learning wird dafür gesorgt, dass auch kleinere Bereiche nicht übersehen werden. Bei einer Messung mit der herkömmlichen Schwellenwertmethode sind in diesem Sichtfeld 46,9 % Austenit vorhanden. Im Vergleich dazu ergibt die Messung mit der Segmentierungsmethode unterstützt durch Machine Learning einen höheren Austenitanteil von 51,2 %.

Bestimmung der Größenverteilung von Nanopartikeln

Die Nanopartikelforschung spielt in zahlreichen Industriebereichen für Produkte wie Arzneimittel, biomedizinische Anwendungen, Beschichtungen, Druckfarben und Farbpigmente, Energieträger oder Filtertechnik eine bedeutende Rolle. Für die Entwicklung von Nanopartikeln mit einzigartigen Eigenschaften, die Verbesserung von Syntheseverfahren Und die Innovation neuer Produkte müssen Größe, Form und chemische Zusammensetzung der einzelnen Nanopartikel genau definiert werden. Auch wenn es Massenanalyseverfahren (wie Sieben oder Laserstreuung) zur Bestimmung der Partikelgrößenverteilung gibt (wenngleich diese Methoden durch die Partikelgröße und/oder Zusammensetzung beschränkt sein können), bleibt die automatisierte Analyse einzelner Nanopartikel in Agglomeraten eine Herausforderung.Da herkömmliche Algorithmen für die Bildsegmentierung die Grenzen zwischen einzelnen Nanopartikeln nicht erkennen, wird diese Art der Analyse immer noch von einem menschlichen Anwender durchgeführt und ergibt daher häufig ungenaue und inkonsistente Ergebnisse.

Abbildung 3 zeigt ein Beispiel für einen umfassenden automatisierten Arbeitsprozess, bei dem einzelne Nanopartikel in Agglomeraten getrennt werden, um die Partikelgrößenverteilung zu ermitteln. Die auf einem Siliziumsubstrat gesammelten Nanopartikel aus den Funken von Ferrocerium wurden mit dem Sekundärelektronendetektor auf einem ZEISS GeminiSEM 500 erfasst[5,6]. Die Machine Learning-Segmentierung von ZEISS ZEN Intellesis wurde erfolgreich zur Identifizierung von drei verschiedenen Klassen eingesetzt: Nanopartikel, Grenze zwischen Nanopartikeln und Hintergrund. Zur weiteren Trennung einzelner Nanopartikel und zur Bestimmung der Größenverteilung wurde in APEER, der cloudbasierten digitalen Mikroskopieplattform von ZEISS (siehe unten), ein Open-Source-Python-Paket (https://scikit-image.org) für eine nahtlose und individuelle Analyse erstellt. Für die Bestimmung einzelner Nanopartikel in Agglomeraten wurde ein automatisierter Arbeitsprozess genutzt, der modernste Mikroskopie, Machine Learning-Bildsegmentierung und Analysen kombiniert. Diese Art von Untersuchung ermöglicht es Forschern, die Beziehungen zwischen Materialeigenschaften besser zu verstehen und so die industrielle Forschung weiter voranzutreiben.

APEER – benutzerfreundliche Module für vereinfachte Arbeitsprozesse in der Mikroskopie

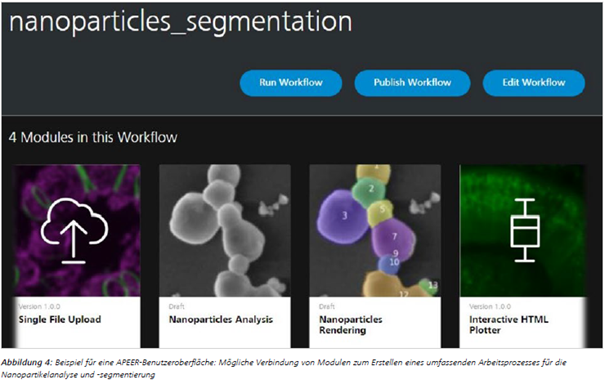

In der industriellen Werkstoffforschung ist oft die Einbindung komplexer Arbeitsprozesse zur Bildverarbeitung und Analyse erforderlich. Wie im obigen Beispiel der Nanopartikel gezeigt, wurden eine Reihe von Tools und Lösungen benötigt, um aussagekräftige Daten aus den Mikroskopbildern zu extrahieren. Auch wenn individuelle Softwarepakete für Analysezwecke existieren, so besteht weiterhin Bedarf an einem modular aufgebauten System und umfassenden, maßgeschneiderten Lösungen, deren Analysen einfach reproduziert und automatisiert durchgeführt werden können.

Abbildung 4 zeigt einen exemplarischen Arbeitsprozess, der für die oben gezeigte Segmentierung von Nanopartikeln verwendet wurde. In diesem konkreten Beispiel wurden vier verschiedene eigenständige Module verbunden, um die Analyse in einfachen Schritten durchzuführen – vom Hochladen des gewünschten Bildes bis hin zur personalisierten Darstellung der Ergebnisse.

Im Bereich der Industriewerkstoffe könnten die Forscher mithilfe von APEER Routineaufgaben erheblich effizienter ausführen und so von weiteren Vorteilen profitieren: mehr Flexibilität beim Erstellen vordefinierter Module und eine Zeitersparnis durch den Einsatz auftragsspezifischer Arbeitsprozesse. Darüber hinaus können Forscher – dank der zentralen, integrierten digitalen Plattform – ihre Ergebnisse mit APEER besser verwalten und dokumentieren.

Bewertung der Schichtdicke

Beschichtungen und Deckschichten werden in vielen verschiedenen Branchen eingesetzt: kosmetisch, funktionell, schützend oder auch nur als Nebenprodukt. Beispiele hierfür sind Lacke, Verzinkungen, thermische Spritzbeschichtungen, Korrosionsschutz, Epoxidharze, physikalische Gasphasenabscheidung, chemische Gasphasenabscheidung und Katalysatorschichten.Die Dicke der Beschichtung(en) und einzelnen Deckschichten hat einen Einfluss auf die Lebensdauer und Leistung eines Produkts. Aus diesem Grund ist die Messung der Schichtdicke von großer Bedeutung – und nicht nur die der durchschnittlichen Dicke, sondern auch der minimalen und maximalen Dicke sowie der Dickenverteilung über eine bestimmte Länge. Die Messung kann manuell oder automatisch erfolgen, und es gibt zahlreiche Normen für die Schichtdickenmessung (z. B. ASTM B487-85[7]), die von der jeweiligen Anwendung abhängen.

In einigen Mikroskopbildern lassen sich Beschichtungen eindeutig von ihrer Umgebung anhand eines Farb- oder Graustufenwerts unterscheiden, der nicht mit dem des Substrats oder Einbettmittels übereinstimmt. In diesen Fällen sind Standardanwendungen für die Bildverarbeitung und Schwellenwertanalyse ausreichend, um die Beschichtung vom Rest zu unterscheiden.

Meistens sind die Unterschiede zwischen Schicht(en) und Substrat für das menschliche Auge deutlich sichtbar, lassen sich aber nur schwer automatisch analysieren. Abbildung 5 zeigt drei Beispiele. Beim verzinkten Stahl stimmen die Graustufenwerte der Beschichtung mit denen des Einbettmittels an mehreren Stellen überein. Die nachfolgende Bildverarbeitung wird dadurch erschwert.

Der durch Hochtemperaturkorrosion entstandene Zunder kann vom Substrat getrennt werden, aber bei einzelnen Schichten innerhalb des Zunders ist dies problematisch, zumal die Poren in einer Phasendarstellung dem Graustufenwert einer anderen Phase entsprechen können.

Bei der Keramikprobe gibt es zwei verschiedene Herausforderungen: die dem Substrat am nächsten liegende Schicht hebt sich vor allem durch ihre Textur und nicht durch Graustufenwerte von dem Substrat ab, und es gibt mehrere Kratzer auf der Probe, die die Grenzen zwischen den Schichten überschreiten. In allen Fällen war ZEISS ZEN Intellesis nach ausreichendem Training in der Lage, die Schichten für nachfolgende quantitative Messungen zu trennen. Dies gelang selbst bei der zerkratzten Probe und anderen metallografischen Präparationsartefakten.

Segmentierung von 3D-Datensätzen bei Schaumglas

Um Materialversagen und -brüche besser zu verstehen, die Entwicklung der Mikrostruktur in Echtzeit zu beobachten und physikalische Simulationen an echten Strukturen durchzuführen, müssen 3D-Bildgebungsverfahren eingesetzt werden. ZEISS ZEN Intellesis ist auch in der Lage, 3D-Datensätze (in einem kompatiblen Format, z. B. .txm, .tiff oder .czi) zu segmentieren, wie sie etwa bei der Röntgenmikroskopie erzeugt werden. Dabei lassen sich beliebige oder alle Schichten des 3D-Datensatzes markieren. Das Modell wird für alle markierten Schichten trainiert, und somit können kleinste Eingaben von allen Markierungen auf allen Schichten stammen. Dabei ist zu erwähnen, dass es bei der 3D-Bildverarbeitung keine Featurevektoren gibt – die Featurevektoren werden schichtweise erstellt. Dieser Effekt kann jedoch durch die Analyse der Daten mit unterschiedlichen Schichtwinkeln und die Bildung von Durchschnittswerten abgeschwächt werden. Ein Beispiel für die Segmentierung von 3D-Datensätzen wird in Abbildung 6 gezeigt. Das Probestück war ein Schaumglasdämmstoff, der in der Bauindustrie eingesetzt wird. Die Forscher wollten die Porosität und die innere Struktur dieser Materialien bestimmen, den Syntheseprozess beim Mischen von Glaspulver und Treibmitteln verbessern und deren thermische Eigenschaften durch physikalische Simulationen an echten 3D-Strukturen simulieren. Um diese Informationen zu extrahieren, eine homogene Porengrößenverteilung zu erhalten, Fehler zu minimieren und die Isolationsfähigkeit zu verbessern, war eine 3D-Bildsegmentierung von Rohdaten erforderlich. Anschließend war ZEISS ZEN Intellesis in der Lage, eine 3D-Darstellung des Präparats zu erstellen. Zu diesem Zweck wurde ein Modell trainiert, das die innere Struktur so segmentiert, dass sowohl große als auch kleinere Poren in den Glaswänden erkannt und folglich genaue Ergebnisse erzielt werden.Der Vergleich klassischer Bildsegmentierungsalgorithmen (globale Multi-Otsu-Schwellenwerte oder Seed-Watershed-Wachstum) mit der Multivarianten-Klassifizierung der Machine Learning-Komponente von ZEISS ZEN Intellesis erfolgte auch für synthetische Bilder aus echten 3D-Datensätzen. Sämtliche Algorithmen funktionierten bei niedrigen Rauschwerten gut, aber die Machine Learning-Klassifizierung war viel unempfindlicher gegenüber Rauschen als die anderen Algorithmen. Zudem war die Machine Learning-Komponente im Gegensatz zu den herkömmlichen Algorithmen in der Lage, eine Segmentierung anhand von Texturkontrasten vorzunehmen. Bei den beiden klassischen Verfahren gab es in den Texturkontrastbereichen (bei einem Rauschpegel von null) in über 50 % der Fälle fehlerhafte Klassifizierungen, während diese Fehlerquote beim Machine Learning auf unter 5 % sank.[8]

Korngrößenbestimmung bei Metallen und Keramiken

Die Eigenschaften der meisten technischen Legierungen und Keramiken hängen stark von der Korngröße und Morphologie ab. Es gibt verschiedene Normen für die lichtmikroskopische Messung von Korngrößen, z. B. ASTM E112[1], oder durch andere Methoden wie der Elektronenrückstreubeugung, z. B. ASTM E2627[9]. Dabei haben alle Methoden einen grundlegenden Aspekt gemeinsam: die Differenzierung eines Korns von seinen Nachbarn. Bei Lichtmikroskopaufnahmen wird dies durch eine entsprechende Ätzung vereinfacht – entweder um die Korngrenze hervorzuheben (typisch für Stähle und Nickellegierungen) oder durch unterschiedliche Färbung der einzelnen Körner gegenüber ihren Nachbarn (z. B. bei einigen Aluminiumlegierungen unter polarisiertem Licht). Sobald einzelne Körner identifiziert wurden, ist die Messung ihrer Größen- bzw. Formverteilung nur noch eine Nebensächlichkeit. Die Abbildungen 7 und 8 zeigen Beispiele für die Korngrenzen-Erkennung in Metallen und Keramiken mittels Licht- und Feldemissions-Rasterelektronenmikroskopie. Das Metall (Legierung 600) wurde auf ein Endmaß von 0,25 μm poliert und anschließend in einer verdünnten Schwefelsäure elektrochemisch geätzt. Die Korngrenzen und auch die Zwillingslinien innerhalb der Körner sind deutlich erkennbar. Allerdings sind die Zwillingslinien heller als die Korngrenzen, und die Korngrenzen-Erkennung war mit der Machine Learning-Komponente einfach zu bewerkstelligen. Die Zirkoniumoxid-Probe stellte eine größere Herausforderung dar: Sie wurde im erhaltenen (unpolierten und unbeschichteten) Zustand in einem ZEISS Sigma 300 FE-SEM mit Sekundärelektronen-Abbildung bei 1 kV untersucht. Die Korngrenzen sind sichtbar, aber es gibt erhebliche Kontrastunterschiede zwischen den Proben sowie zwischen mehreren Poren. Mit der Machine Learning-Komponente in ZEISS ZEN Intellesis war es möglich, die Korngrenzen zur Bestimmung der Korngröße bzw. -form direkt zu segmentieren und gleichzeitig die Porengröße-, -form und -verteilung zu erkennen und zu messen.Fazit

Die Bildsegmentierung ist ein wichtiger Schritt für Forscher in der Industrie, Werkstoffwissenschaftler und Techniker, die aus ihren 2D- oder 3D-Mikroskopaufnahmen aussagekräftige Informationen gewinnen möchten. Sie können ihre Forschungsarbeit verbessern, die Produktivität steigern und genauere Ergebnisse erzielen. Auch wenn es klassische schwellenwertbasierte Methoden und Machine Learning-Algorithmen gibt, erfordert deren effektive und genaue Anwendung oft Fachwissen und Erfahrung im Bereich der Bildsegmentierung.Ohne eine automatisierte Bildsegmentierung sind möglicherweise eine anwendergestützte Analyse sowie viele Stunden manueller Untersuchungen erforderlich. In schnelllebigen Industrieumgebungen ist eine zuverlässige Plattform für die Bildsegmentierung unverzichtbar, denn sie ermöglicht die Reproduzierbarkeit und Genauigkeit der Ergebnisse – bei gleichzeitiger Zeitersparnis.

Mit ZEISS ZEN Intellesis erhalten Unternehmen und Einzelpersonen, die mit Industriewerkstoffen arbeiten, all diese Vorteile – und eine Lösung, die sich vollständig in die ZEISS ZEN Softwareplattform integrieren lässt. Von der Korngrößenanalyse bei Metallen oder Keramiken, der Größenverteilung von Nanopartikeln in Agglomeraten oder der Schicht- und Phasenanalyse von Materialien bis hin zur Porosität und dem Export von originalgetreuen 3D-Strukturen für physikalische Simulationen verarbeitet ZEISS ZEN Intellesis effizient alle gängigen Bildformate (Farbe und Graustufen) und ermöglicht so eine nahtlose Bildsegmentierung.

Eine kostenlose Testversion von ZEISS ZEN Intellesis steht auf der ZEISS Website (https://www.zeiss.com/intellesis) zur Verfügung und kann zur Anwendung auf anspruchsvollste Mikroskopbilder heruntergeladen werden. Nutzen Sie die Vorzüge eines einfach zu bedienenden und integrierten ZEISS ZEN Ökosystems, um schneller mehr Informationen aus Mikroskopbildern von Industriewerkstoffen zu erhalten. Kombinieren Sie Lösungen von ZEISS Microscopy mit Machine Learning-gestützter Bildsegmentierung und modularen Arbeitsprozessen, um innovative Produkte für Ihre Branche zu entwickeln.

Quellennachweise

[1] ASTM E112-13 „Standard Test Methods for Determining Average Grain Size“

[2] ISO 945-1:2017 „Mikrostruktur von Gusseisen - Teil 1: Graphitklassifizierung durch visuelle Auswertung“

[3] ASTM E45-18 „Standard Test Methods for Determining the Inclusion Content of Steel“

[4] ASTM E2109-01(2014) „Standard Test Methods for Determining Area Percentage Porosity in Thermal Sprayed Coatings“

[5] Zhou, Fang, et al. „Characterizing InGaAs/GaAs quantum dots using low-kV FESEM imaging and EDS analysis at the nanometer scale.“ Microscopy and Microanalysis 22.S3 (2016): 1586-1587.

[6] Alfonso, C., et al. „Low kV High Resolution Scanning Electron Microscopy Study of Si Nanowire Surfaces.“ Microscopy and Microanalysis 21.S3 (2015): 1261-1262.

[7] ASTM B487-85(2013) „Standard Test Method for Measurement of Metal and Oxide Coating Thickness by Microscopical Examination of Cross Section“

[8] Andrew M. „A quantified study of segmentation techniques on synthetic geological XRM and FIB-SEM images“ Computational Geosciences, August 2018. https://doi.org/10.1007/s10596-018-9768-y

[9] ASTM E2627-13 „Standard Practice for Determining Average Grain Size Using Electron Backscatter Diffraction (EBSD) in Fully Recrystallized Polycrystalline Materials“